Mirantis k0rdent Enterprise verbindet VM- und Container-Workloads mit spezialisierten KI-Anwendungen über eine zentrale, cloudnative Plattform. Auf der KubeCon + CloudNativeCon Atlanta präsentierte Version bietet umfassendes Lifecycle-Management für Cloud-, On-Premises- und Edge-Szenarien. Automatisierte Orchestrierungsmechanismen reduzieren manuelle Eingriffe, während der Distributed Resource Balancer freie Ressourcen erkennt und ausgleicht. GPU-Passthrough, NUMA-Unterstützung und Hugepages optimieren die Performance von KI-Workloads bei gleichzeitiger Reduzierung von Infrastrukturkosten. Sie stellt Echtzeitmetriken, Rollenmanagement und automatische Updates einfach bereit.

Inhaltsverzeichnis: Das erwartet Sie im Artikel

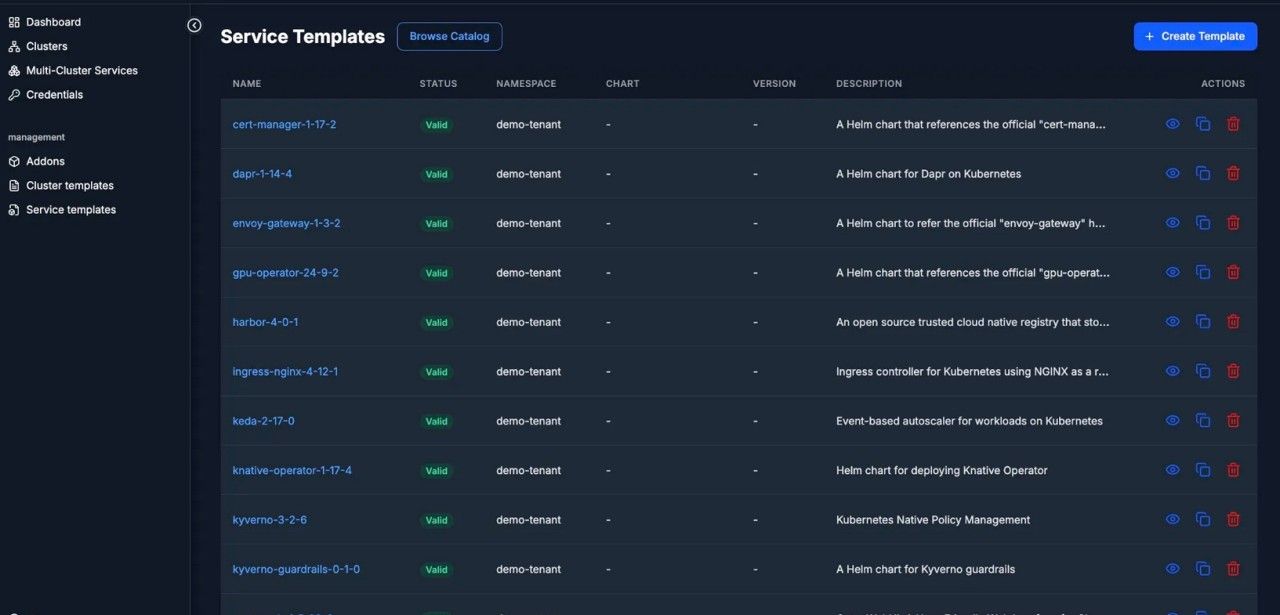

Validierte Templates aus Mirantis Ökosystem gewährleisten Kubernetes und VM-Infrastrukturen

Mirantis k0rdent Enterprise erweitert k0rdent Kubernetes-Management um Virtualisierung. Plattformingenieure setzen deklarative Automatisierung ein, orchestrieren Ressourcen per GitOps und nutzen geprüfte Templates aus dem Mirantis-Ökosystem für stabile, policy-konforme Infrastrukturen. Dank Integration der CNCF-Sandbox k0s werden Container und virtuelle Maschinen gemeinsam und verteilt bereitgestellt. Das Ergebnis sind schnellere Bereitstellungsvorgänge, weniger Konfigurationsaufwand und erhöhte Betriebssicherheit. Die einheitliche Oberfläche vereinfacht Management, Monitoring und Updates über heterogene Cloud-, On-Premises- und Edge-Umgebungen hinweg und skaliert optimal.

Automatisches Node Balancing durch DRB sichert gleichbleibende Performance mühelos

Der DRB nutzt intelligente Algorithmen, um kontinuierlich verfügbare CPU- und RAM-Pools auf Clusterknoten zu identifizieren und bietet automatisches Load-Balancing ohne menschliches Zutun. Auslastungsungleichheiten werden selbsttätig ausgeglichen, wodurch konstante Antwortzeiten und verbesserte Servicequalität gewährleistet sind. Kapazitätsplaner entfallen, da der Balancer ohne manuelle Konfiguration operiert. Gleichzeitig sinkt administrativer Aufwand, während Teams Echtzeit-Übersichten über Ressourcenauslastung erhalten und Systemressourcen optimal verteilt werden. Unterbrechungsfreie Betriebszeiten und Kostenersparnis steigern Effizienz. Ressourcenoptimierung erfolgt automatisch. Skalierung wird erleichtert.

GPU-Passthrough sorgt für maximale Beschleunigung bei KI-Workloads in Enterprise-Umgebungen

Mit Mirantis k0rdent Enterprise folgt die Architektur exakt der Mirantis KI-Referenz, um optimale Bedingungen für KI-Workloads zu schaffen. Die NUMA-Topologie bleibt intakt, was eine gezielte Allokation von Speicher und CPU-Kernen ermöglicht. GPU-Passthrough stellt sicher, dass Grafikeinheiten direkt adressiert und vollständig genutzt werden. In Kombination mit Hugepages, die große Arbeitsspeicherblöcke reservieren, und CPU-Pinning, das Kerne fest zuweist, entsteht eine leistungsstarke und konsistente Umgebung für maschinelles Lernen mit stabilem Durchsatz und Effizienz.

Einheitliches Management reduziert Silos steigert Übersicht und senkt Betriebskosten

Mit dem zentralen Verwaltungstool lässt sich die Virtualisierung über Cloud-, On-Premises- und Edge-Umgebungen hinweg automatisiert ausrollen und skalieren. Eine durchgängige Übersicht aller Workloads sorgt für fundierte Entscheidungen, indem Kostenströme, Ressourcenauslastung und Performance-Metriken einsehbar gemacht werden. Dies schafft Transparenz, minimiert Insellösungen und vereinfacht das Reporting. Durch den Wegfall manueller Koordination sinken Betriebsausgaben und der Administrationsaufwand erheblich, während gleichzeitig die Gesamtproduktivität der IT-Infrastruktur gesteigert wird. Effizientere Prozesse steigern deutlich Release-Geschwindigkeit und Skalierbarkeit.

Open-Source Virtualisierung mit Mirantis Kubernetes Engine k0rdent MKE 4k

Die Kombination aus KubeVirt 1.6 und Ceph 19.2.3 Squid in Mirantis k0rdent Enterprise schafft eine moderne Plattform für softwaredefinierten Speicher mit verbesserter Fehlertoleranz und Performance. Entwickler und Operatoren profitieren von automatisierten Provisionierungsprozessen und dynamischer Speichererweiterung. Parallel dazu ermöglicht die Mirantis Kubernetes Engine for k0rdent (MKE 4k) die native Ausführung von virtuellen Maschinen neben Containern. So steht eine quelloffene Alternative zu proprietären Virtualisierungssystemen bereit, die Architekturvielfalt und Resilienz fördert und Skalierbarkeit.

KI-optimierte Konfiguration und GPU-Passthrough steigern VM-Leistung in Echtzeit deutlich

Die Kombination aus Mirantis k0rdent Enterprise und MKE 4k ermöglicht es, containerisierte Dienste, virtuelle Maschinen und KI-basierte Anwendungen über eine konsistente Managementebene zu betreiben. Dank automatischer Workload-Orchestrierung mit integriertem Ressourcenabgleich erhalten Teams gleichbleibende Performance und vermeiden Engpässe bei Spitzenlasten. Die KI-optimierte Konfiguration nutzt GPU-Passthrough und NUMA-Topologie für erhöhte Effizienz. Multi-Cloud-, On-Premises- und Edge-Szenarien werden nahtlos unterstützt, was Komplexität und Gesamtbetriebskosten nachhaltig senkt. skalierbar modular wartungsleicht automatisiert sicher dokumentiert flexibel integriert.